Étape 4 : Générer des cas de test

Cette dernière étape se déroule côté utilisateur : un testeur lance une génération depuis une exigence. Si la génération aboutit, c'est que la chaîne complète Serveur → Prompts → Projet est correctement configurée.

Prérequis

- Étapes 1, 2 et 3 terminées.

- Licence SquashTM Ultimate 💎.

- L'utilisateur dispose des droits de lecture des exigences sur ce projet et de création de cas de test sur au moins un projet.

- Le projet contient au moins une exigence renseignée (un nom et une description suffisent pour un premier test).

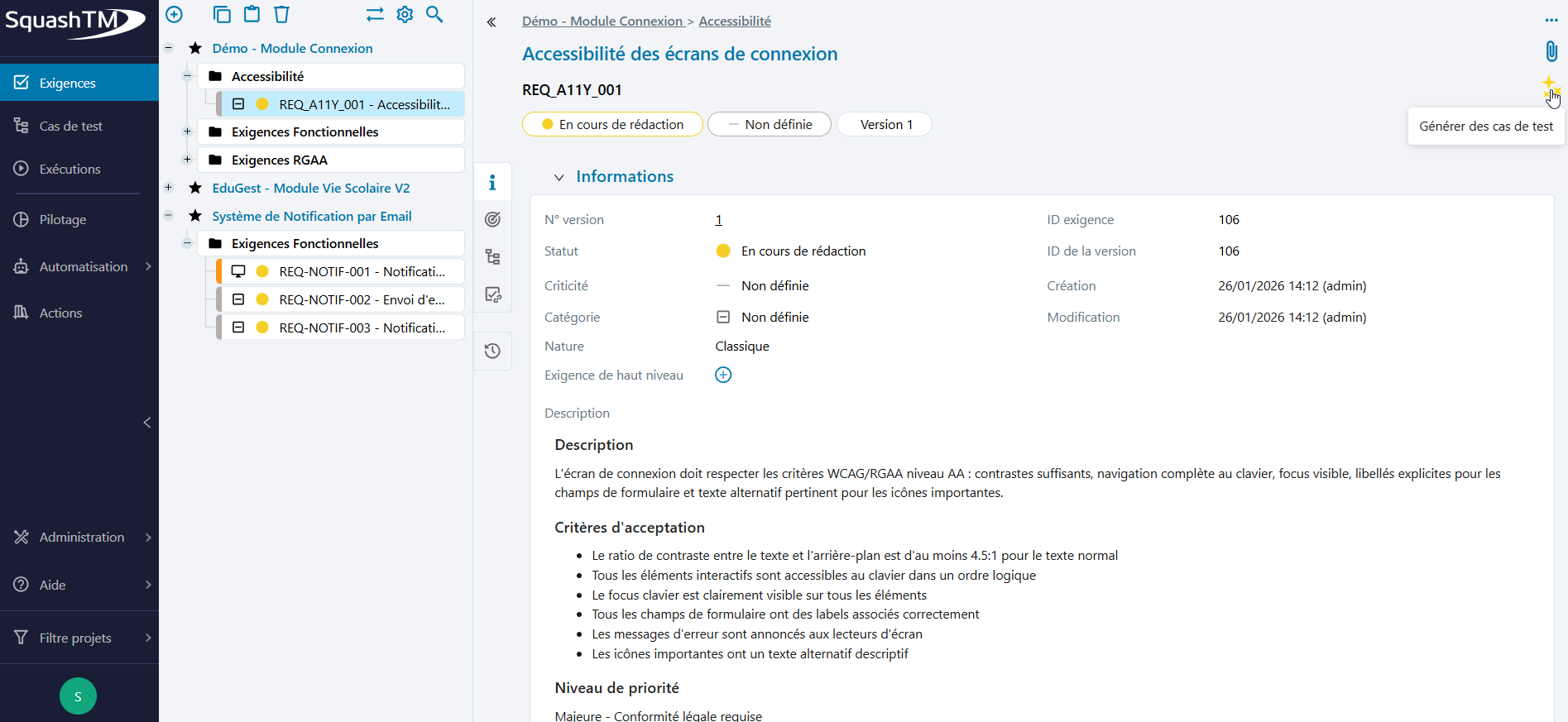

Lancer la génération

Ouvrez une exigence du projet configuré. Dans le menu en haut à droite de l'écran, cliquez sur Générer des cas de test.

Le bouton n'apparaît pas ?

Voir la section En cas de problème plus bas.

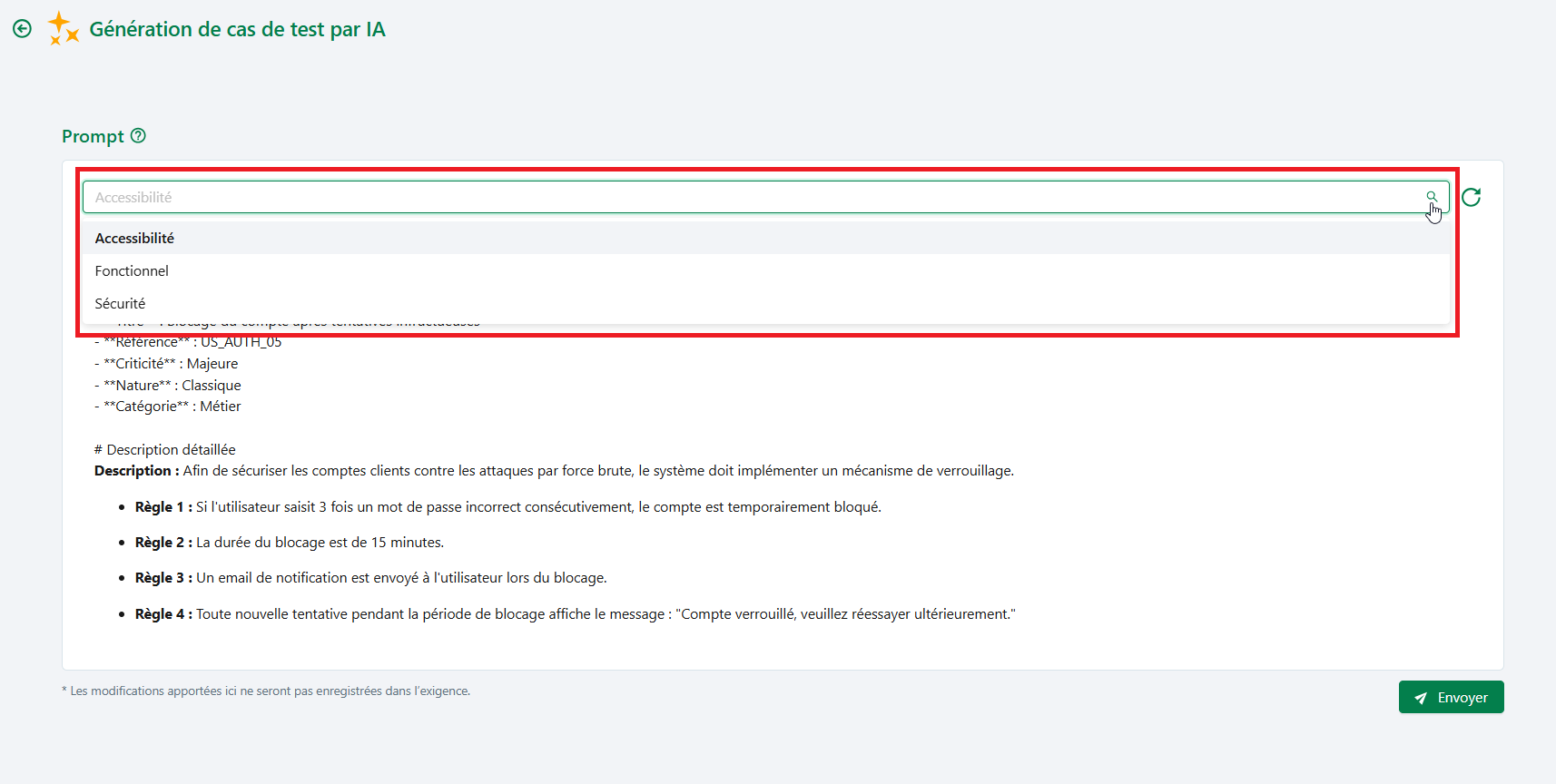

Choisir et adapter le prompt

Sélectionnez le prompt souhaité dans la liste déroulante. Pour un premier test, la Génération standard est suffisante. Vous pouvez ajuster le texte du prompt avant envoi (par exemple pour préciser un nombre de cas de test attendus). Les modifications apportées ici au texte du prompt ne sont pas répercutées sur l'exigence source.

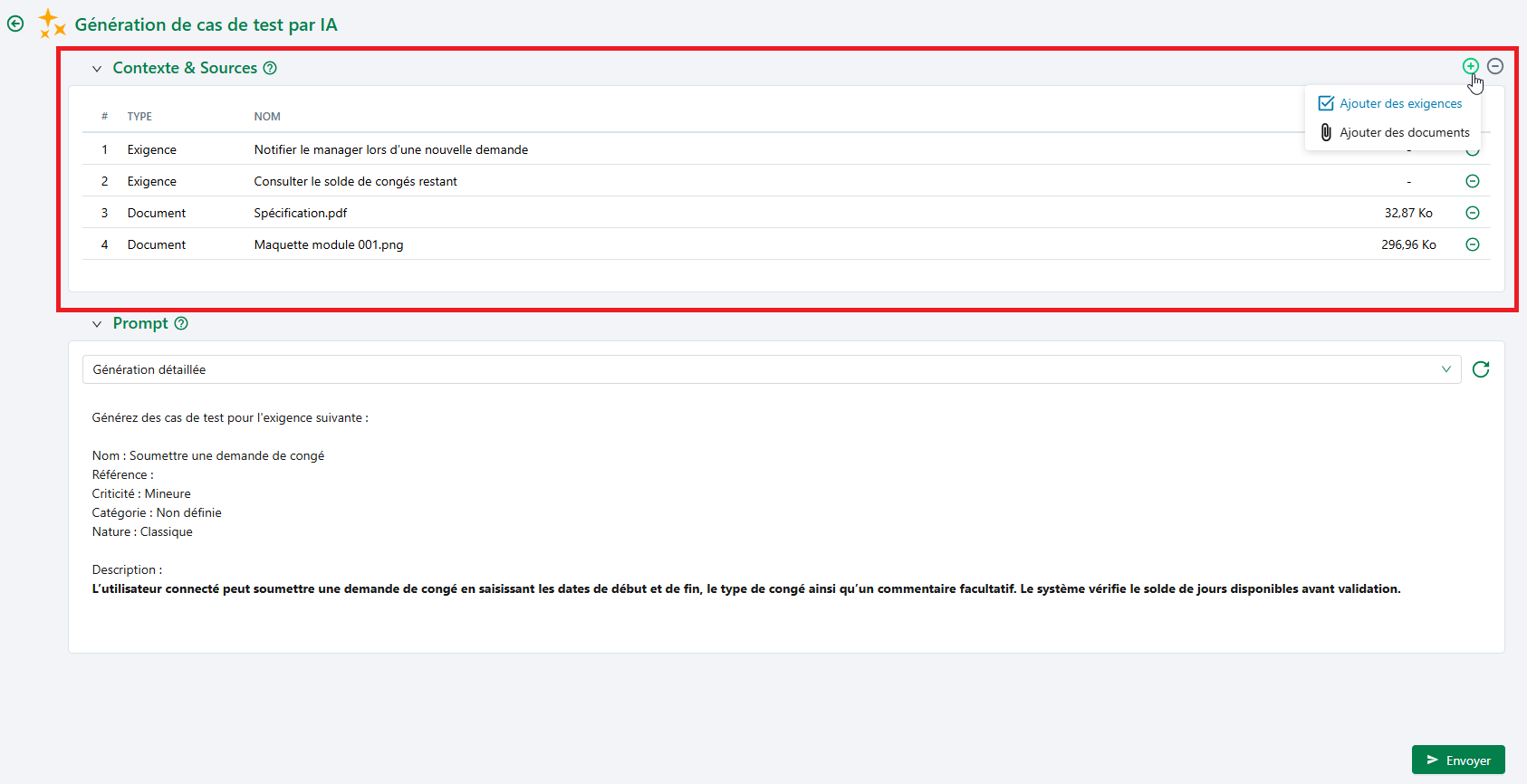

(Optionnel) Enrichir avec du contexte

Si l'ensemble de prompts associé au projet contient un modèle d'encapsulation du contexte, le panneau Contexte & Sources s'affiche. Vous pouvez y ajouter des exigences et des documents pour enrichir la génération.

Formats et taille des documents

Les formats de fichiers acceptés et la taille cumulée maximale autorisée sont définis par l'administrateur sur la page du serveur d'IA. Si l'ajout d'un document est refusé, rapprochez-vous de lui. Pour le détail, consultez Limitations pour les documents du contexte.

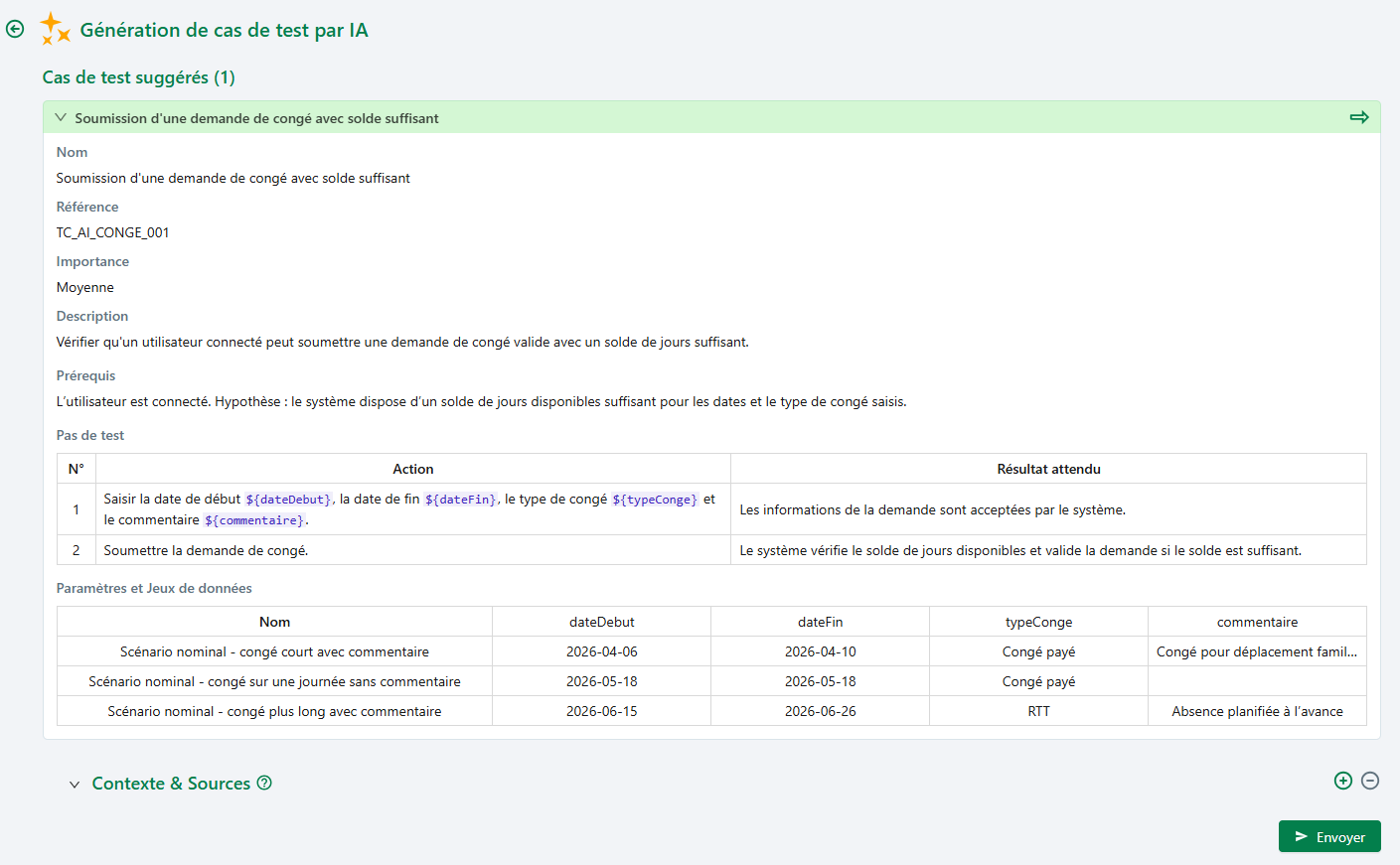

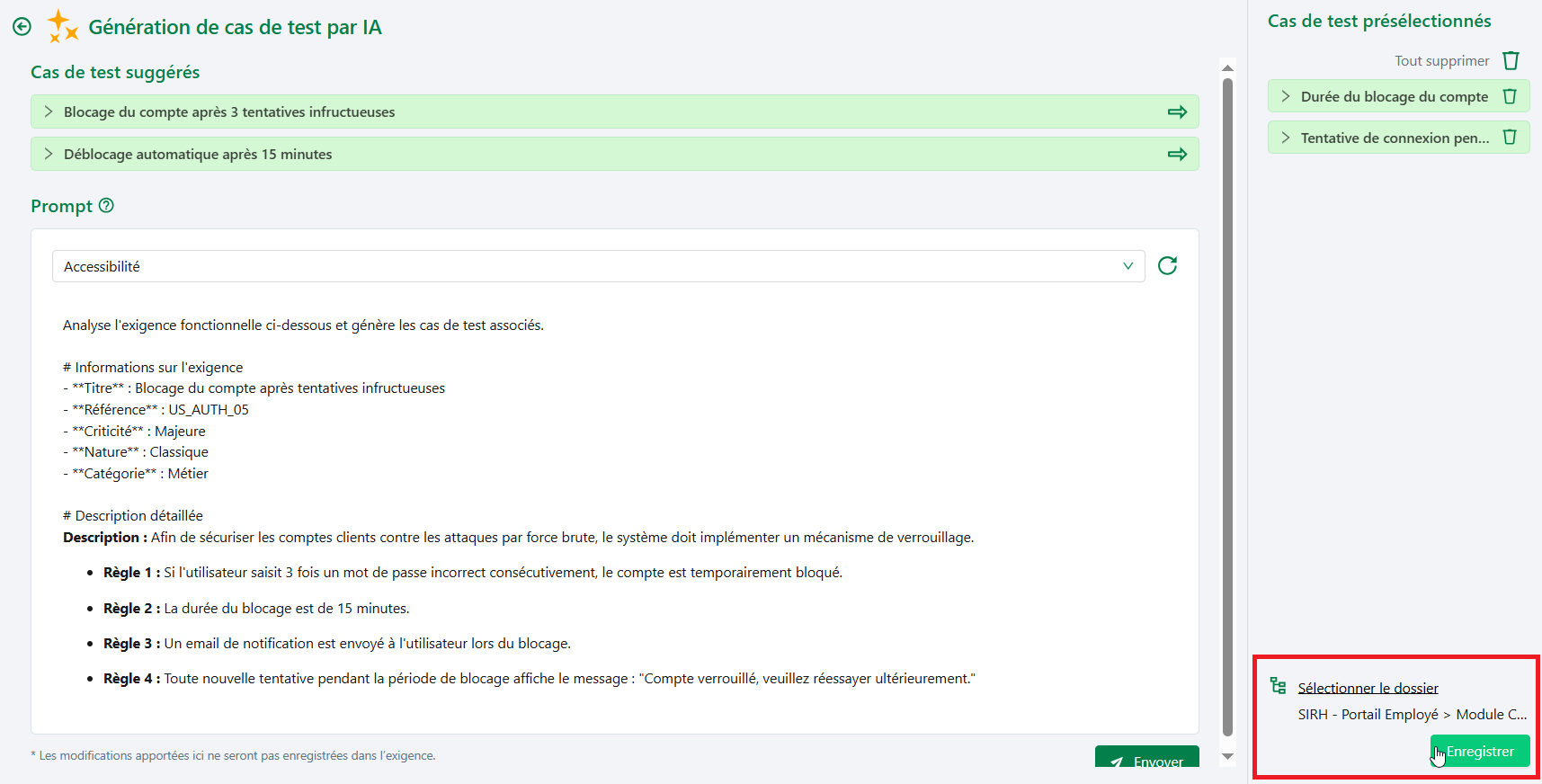

Examiner les suggestions

Cliquez sur Envoyer. Les cas de test suggérés s'affichent dans la partie principale. Chaque suggestion peut être dépliée pour consulter les pas de test, prérequis, importance, référence et jeux de données éventuels.

Sélectionner et enregistrer

Sélectionnez les cas de test à conserver via la flèche verte ou en les glissant-déposant dans le panneau de présélection à droite. Choisissez ensuite un emplacement de destination, puis cliquez sur Enregistrer.

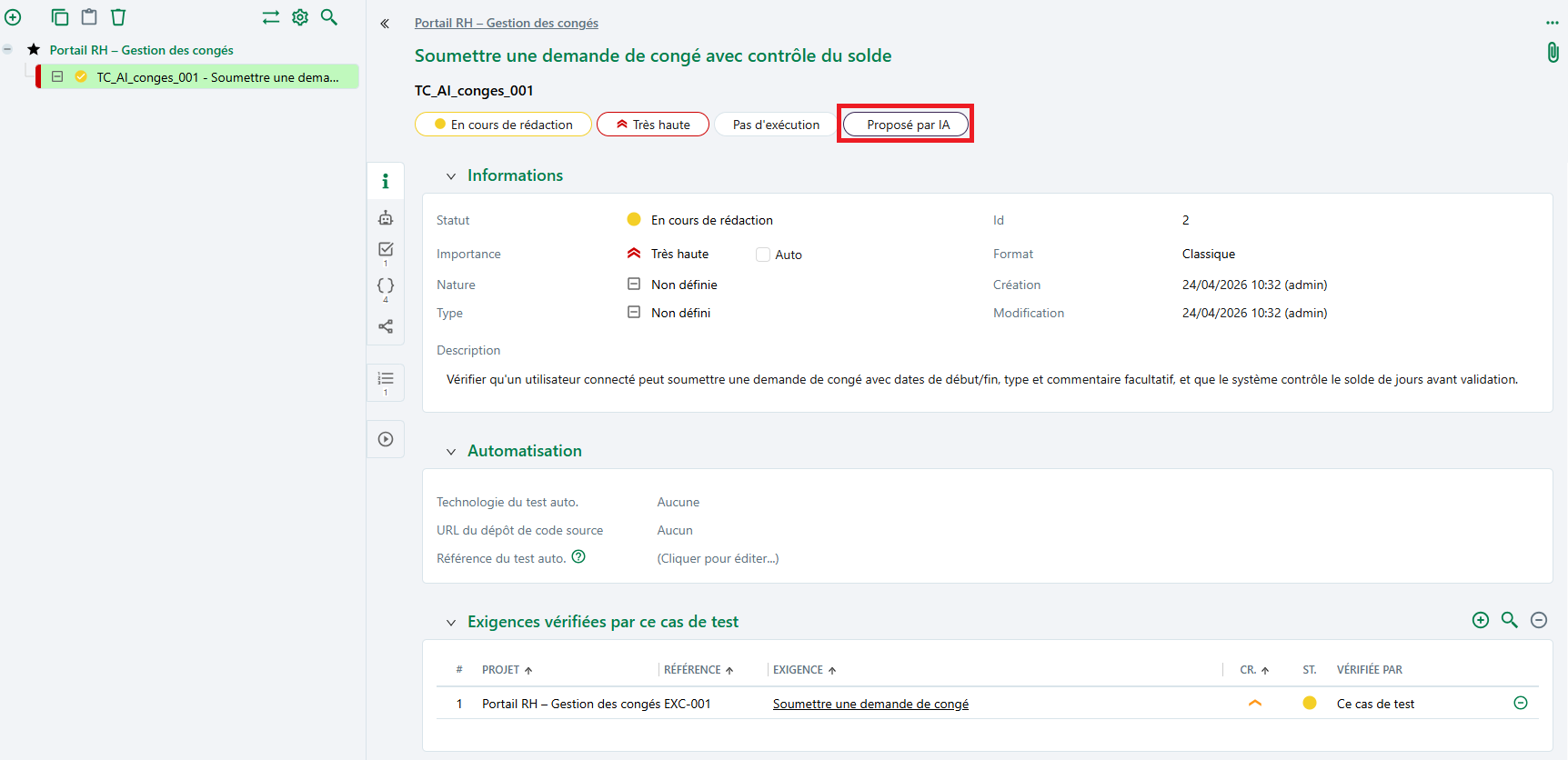

Les cas de test enregistrés sont créés dans l'espace Cas de test, automatiquement liés à l'exigence d'origine, identifiés par la mention Proposé par IA et restent entièrement modifiables.

Si la génération aboutit et que les cas de test sont enregistrés correctement, la configuration de bout en bout est validée. 🎉

En cas de problème

Si quelque chose ne fonctionne pas, voici les vérifications classiques :

| Symptôme | Étape à vérifier |

|---|---|

| L'action Générer des cas de test n'apparaît pas dans le menu de l'exigence. | Étape 3 : un serveur d'IA et un ensemble de prompts sont-ils bien associés au projet ? L'utilisateur a-t-il les droits de lecture des exigences et de création de cas de test ? |

| L'action est présente mais la liste des prompts est vide. | Étape 2 : l'ensemble associé contient-il au moins un prompt ? |

| Le panneau Contexte & Sources n'apparaît pas. | Étape 2 : le prompt sélectionné a-t-il un modèle d'encapsulation du contexte renseigné ? |

| Erreur à l'envoi (clé invalide, modèle inconnu, timeout…). | Étape 1 : retournez sur la page du serveur et relancez le bouton de test. Le message d'erreur brut renvoyé par l'API y est affiché. |

| La réponse de l'IA est rejetée comme « JSON invalide ». | Étape 2 : le modèle du prompt système doit imposer une sortie strictement JSON, sans balises de code ni commentaires. Inspirez-vous des prompts par défaut. |

Pour aller plus loin

- Gérer les serveurs d'intelligence artificielle : paramètres avancés par fournisseur.

- Gérer un serveur d'IA personnalisé : pour les fournisseurs non natifs.

- Gérer les ensembles de prompts : syntaxe Handlebars, exemples complets, jeux de données.

- Écrire des cas de test avec l'aide de l'IA : guide utilisateur complet (multi-envoi, vidage de la sélection, comportement à la fermeture, etc.).